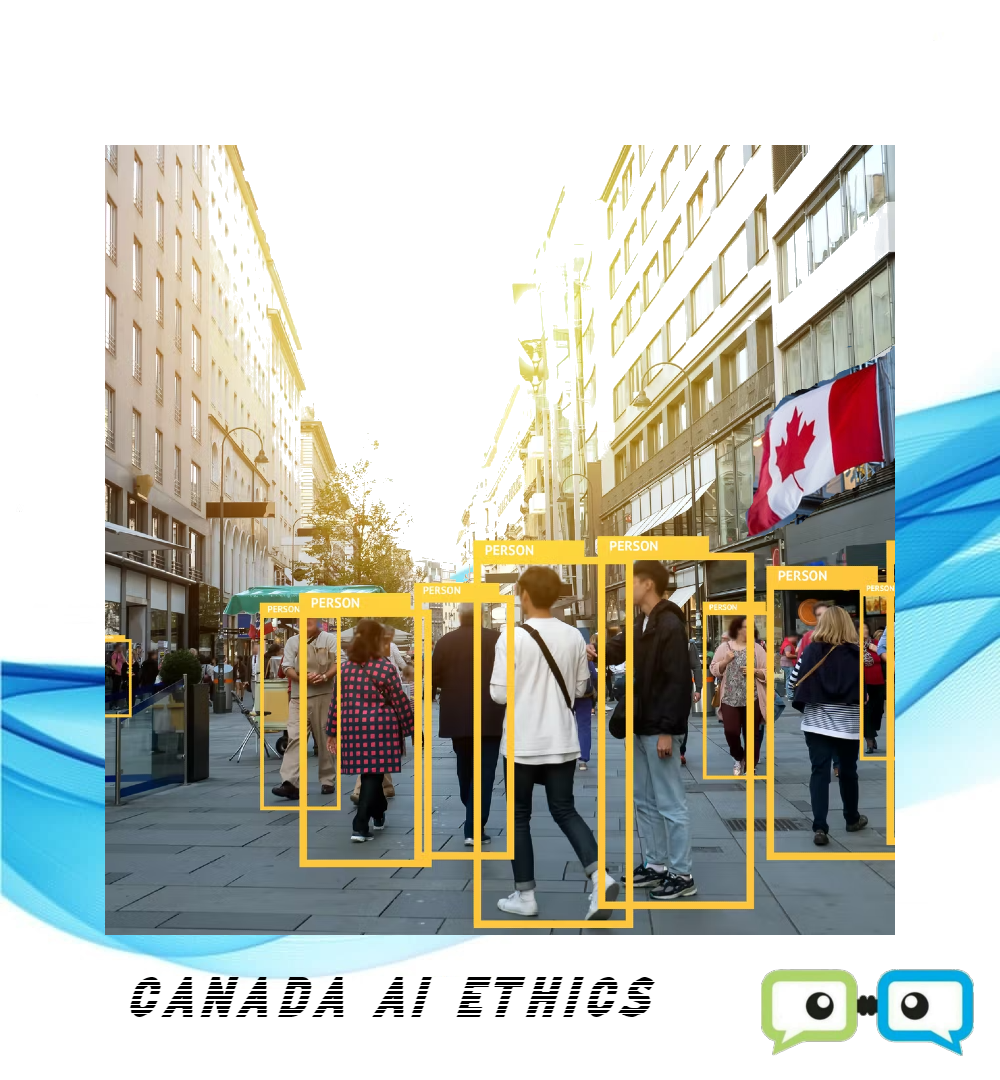

canada-ai-ethics

کانادا هوش مصنوعی دولت را در زمینه اخلاق و همکاری جهانی رهبری می کند

همانطور که هوش مصنوعی (AI) و یادگیری ماشینی به آرامی راه خود را به زندگی روزمره ما وارد می کنند، ترس از اعمال تبعیض آمیز و نقص فنی در حال تبدیل شدن به واقعیت است.

اجماع اندک جهانی در مورد ظاهر هوش مصنوعی مسئول و سرفصل هایی که تبعیض ناشی از فرآیندهای الگوریتمی را مستند می کنند، برخی از ابتکارات هوش مصنوعی بخش عمومی را در هاله ای از ابهام قرار داده است.

با این حال، در سالهای اخیر، دولتها در سراسر جهان به آرامی هوش مصنوعی و یادگیری ماشین را در فرآیندهای مدیریت داده و اتوماسیون برای بهبود خدمات باطنی و عمومی وارد کردهاند.

به عنوان مثال، در ایالات متحده، اداره امور کهنه سربازان (VA) از هوش مصنوعی در برنامه REACH VET خود استفاده می کند تا جانبازانی را که در معرض خطر بالای خودکشی هستند مشخص کند.

آخرین به روز رسانی برنامه استراتژیک تحقیق و توسعه هوش مصنوعی ملی کاخ سفید که در اوایل سال جاری منتشر شد، شامل اضافه شدن مشارکت های دولتی-خصوصی به عنوان یک منطقه تمرکز جدید برای کمک به تسریع ابتکارات هوش مصنوعی فدرال است.

از سوی دیگر، کانادا به عنوان یک رهبر جهانی در مقررات هوش مصنوعی شناخته شده است چون نگرانی های پیرامون هوش مصنوعی مانند تعصب و مسئولیت پذیری را بررسی می کند.

با توجه به سرمایه گذاری های طولانی مدت و در مقیاس بزرگ این کشور در هوش مصنوعی، مزیت کانادا جای تعجب ندارد.

الیسا استروم، مدیر اجرایی استراتژی هوش مصنوعی پان-کانادایی در موسسه تحقیقات پیشرفته کانادا (CIFAR)، توضیح داد که رهبری هوش مصنوعی کانادا در پرسنل آینده نگر آن نهفته است.

استروم گفت: «ما سابقه طولانی مدتی داریم که برخی از محققان برجسته جهان را در زمینه هوش مصنوعی در کانادا داریم.

“استعداد بزرگترین دارایی ما در کانادا است، بنابراین ما استراتژی خود را حول حفظ آن استعداد و ایجاد استعدادها ساخته ایم.”

داده ها این ادعا را تایید می کند. طبق گزارش آژانس جهانی جذب و ترویج سرمایه گذاری کانادا، Invest in Canada، از سال 2016 تا 2017، کانادا 1.3 میلیارد دلار برای تحقیق و توسعه هوش مصنوعی سرمایه گذاری کرده است.

تورنتو دارای بیشترین تمرکز استارت آپ های هوش مصنوعی و مونترال دارای بالاترین تمرکز دانشجویان و محققانی است که هوش مصنوعی را در جهان مطالعه می کنند.

استعداد و پول پشتیبان هوش مصنوعی کانادایی چشمگیر است، اما تعهد این کشور به استفاده اخلاقی از هوش مصنوعی و تصمیم گیری خودکار در بخش عمومی است که آن را متمایز می کند.

گام های پیشگامانه در هوش مصنوعی کانادا

در حالی که تبعیض هوش مصنوعی چیز جدیدی نیست، گزارش ماه آوریل توسط محققان موسسه AI Now در دانشگاه نیویورک پس از ابراز نگرانی در مورد سوگیری ساختاری احتمالی، دوباره بحث را برانگیخت.

بر اساس تجزیه و تحلیل AI Now، نیروی کار سفیدپوست مرد در صنعت هوش مصنوعی در حال ورود به قابلیت های الگوریتمی است.

نظرسنجی موسسه AI Now از بیش از 150 مطالعه و گزارش در مورد هوش مصنوعی نشان داد که سوگیری در سیستمهای هوش مصنوعی فعلی منعکس کننده الگوهای تاریخی تبعیض است و در نهایت خواستار ارزیابی مجدد سیاستهای هوش مصنوعی و محل کار شد.

برای مثال، در سال 2016، یک ارزیاب خودکار عکس پاسپورت در نیوزیلند به مردی آسیایی تبار گفت که چشمانش بسته است، حتی اگر به وضوح باز باشد.

دو سال بعد، آمازون سیستم استخدام یادگیری ماشینی را که پس از شناخت الگوهای تسلط مردان در صنعت فناوری به مردان علاقه مند بود، کنار گذاشت.

به عبارت دیگر، دادههایی که سیستمهای خودکار مبتنی بر آن هستند، همیشه تنوع کاربران را در بر نمیگیرد.

اما کانادا سخت کار می کند تا استانداردهای اخلاقی هوش مصنوعی را حفظ کند.

این دستورالعمل یک دستورالعمل در حال تحول درباره تصمیمگیری خودکار منتشر کرد که دولت را وادار میکند در عین حفظ شفافیت، پاسخگویی، قانونی بودن و انصاف رویهای، به استفاده از هوش مصنوعی متعهد شود.

ناتالی مک گی، مدیر اجرایی برنامه ریزی استراتژیک سازمانی برای دبیرخانه هیئت خزانه داری کانادا، توضیح داد که چگونه دولت کانادا در تلاش است تا نگرانی های هوش مصنوعی در بخش عمومی را برطرف کند.

مک گی گفت: «دولت میداند که قبل از استفاده از فناوری [AI]، ما واقعاً نیاز داریم که به سوگیری و الزامات استفاده مسئولانه نه تنها برای شفافیت، بلکه برای پاسخگویی در استفاده از اتوماسیون رسیدگی کنیم.»

به همین دلیل است که دولت کانادا و شرکتهای تحقیقاتی قبلاً گامهایی را برای اجرای ابتکارات هوش مصنوعی اخلاقی و مسئولانه از نظر نیروی کار و فنی برداشتهاند.

استراتژی هوش مصنوعی پان-کانادایی، که نشان دهنده اولین استراتژی ملی هوش مصنوعی است که توسط هر کشوری توسعه یافته است، یک ابتکار تحقیق و نوآوری برای تقویت کانادا به عنوان یک مرکز تحقیقاتی هوش مصنوعی است. هدف این استراتژی همچنین متحد کردن رهبران فکری برای بررسی پیامدهای اجتماعی هوش مصنوعی قبل از اجراست.

به عنوان بخشی از این استراتژی، CIFAR برنامه های آموزشی را برای دانشجویان کالج اجرا می کند که برابری، تنوع و شمول را ترویج می کند.

برای مثال، AI for Good Summer Lab، فرهنگهای فناوری فراگیر را با توانمندسازی زنان ترویج میکند.

برنامه دیگری به نام Data Science for Social Good، با سازمان های عمومی برای استخراج بینش بر اساس مجموعه داده های آنها را به اشتراک می گذارد.

پروژه های 2019 شامل استفاده از یادگیری ماشینی برای طبقه بندی نتایج آزمایش های آزمایشگاهی است که توسط مرکز کنترل بیماری BC حمایت می شود.

مک گی توضیح داد که دولت در حال حاضر به قوانین موجود، مانند منشور حقوق و آزادی های کانادا، برای اجرای سیاست هایی که از شهروندان در برابر هوش مصنوعی و تبعیض تصمیم گیری خودکار محافظت می کند، تکیه می کند.

این فرآیند شامل حصول اطمینان از این است که تصمیمات بر اساس دادههای با کیفیت بالا و بیطرفانه است، ارزیابی تأثیر تصمیمگیریشده و برای شهروندان در صورت اشتباه بودن فناوری پذیرش می کند.

به عنوان مثال، دولت یک ارزیابی تاثیر الگوریتم را برای امتیاز دهی به سطوح بالقوه ریسک اجرا کرد.

هدف از این کار، ارائه گامهای عملی به آژانسهایی است که میخواهند هوش مصنوعی را پیادهسازی کنند تا پیش از وقوع ناهماهنگیها را اصلاح کنند.

مدیران پروژه یا کاربران نهایی به 60 تا 80 سوال پاسخ میدهند تا مشخص کنند فناوریای که میخواهند پیادهسازی کنند کم خطر است یا پر خطر.

این نتایج به سیاست های کانادا در مورد چگونگی پیشبرد پروژه گره خورده است.

مک گی گفت: «از طریق خط مشی اداری موجود، ما معنای واقعی گنجاندن استفاده مسئولانه و اخلاقی در تصمیم گیری خودکار را معرفی کرده ایم.

به گفته مک گی، کانادا به جای تلاش برای حل هر مشکلی از ابتدا، توانست با تکیه بر استانداردهای دیجیتالی کشور و مقابله با اولین مشکل، یعنی خودکارسازی، اولین استراتژی ملی جهان را در استفاده مسئولانه و اخلاقی از هوش مصنوعی معرفی کند.

از دیدگاه تحقیقاتی در CIFAR، حل اختلافات تعصب و تبعیض پیرامون هوش مصنوعی مستلزم بازنگری در خود فناوری و اجرای آن است.

استروم گفت: «مسئلههای مربوط به برابری، تنوع و شمول حوزهای است که ما باید در حال حاضر بیشترین توجه را به آن داشته باشیم، چه ما در مورد برابری، تنوع و گنجاندن در جمعیت افرادی صحبت میکنیم که به این امر کمک میکنند. توسعه این فناوری یا ما در مورد حصول اطمینان از این موضوع صحبت می کنیم که استفاده از فناوری هوش مصنوعی از برابری، تنوع و شمول حمایت و پیشرفت می کند.

برای رفع این نگرانیها، تیم CIFAR ارتباط با زنان و سایر گروههایی که در بخش فناوری حضور کمتری دارند، در اولویت قرار داده است.

این تیم به فراسوی مرزهای ملی میرود تا نیروهای جدید پیدا کند و با درگیر کردن کارمندان با استعداد از پیشینههای مختلف، احتمال تعصب و تبعیض در محصول نهایی را کاهش دهد.

در مقایسه با ایالات متحده چطور؟

از سال 2016، زمانی که برنامه استراتژیک اولیه هوش مصنوعی تحت ریاست جمهوری باراک اوباما منتشر شد، اجرای فدرال هوش مصنوعی رشد کرده و تغییر کرده است.

ابتکار هوش مصنوعی آمریکایی قابل توجه ترین تعدیل دولت ترامپ برای اجرا بود که شامل سرمایه گذاری در تحقیق و توسعه، تنظیم استانداردهای حاکمیتی و ایجاد نیروی کار برای یک شرکت هوش مصنوعی بود.

این قدم ها نسبتا کند بوده است. در حالی که موسسه ملی استانداردها و فناوری (NIST) هنوز در حال توسعه طرحی برای استفاده فدرال است که شامل استانداردهای فنی برای هوش مصنوعی میشود، آژانسها پیادهسازی رویکردهای خود را آغاز کردهاند – و موفقیتهای چشمگیری را شاهد بودهاند.

مؤسسه ملی بهداشت (NIH) در حال یافتن راه های جدیدی برای استفاده از هوش مصنوعی در تحقیقات زیست پزشکی است.

محققان NIH از هوش مصنوعی برای تشخیص ضربان قلب نامنظم استفاده کرده اند که به توانایی آن در بهبود خوانش نوار قلب (EKG) اشاره دارد.

وزارت دفاع (DoD) نه تنها یک مرکز اطلاعاتی اختصاص داده شده به هوش مصنوعی ایجاد کرده است، بلکه یک استراتژی برای مشارکت با سازمان های بخش خصوصی برای گنجاندن هوش مصنوعی در ماموریت های کلیدی منتشر کرده است.

دانا دیزی، مدیر ارشد اجرایی وزارت دفاع آمریکا در هنگام انتشار استراتژی آژانس خود خاطرنشان کرد که همکاری برای اجرای موفقیتآمیز استراتژی هوش مصنوعی وزارت دفاع مهم است.

او گفت: “موفقیت ابتکارات هوش مصنوعی ما بر روابط قوی با شرکای داخلی و خارجی متکی خواهد بود.” بین سازمانی، صنعت، متحدان ما و جامعه دانشگاهی همگی نقشی حیاتی در اجرای استراتژی هوش مصنوعی ما خواهند داشت.

مقامات کانادایی همچنین پیشنهاد کردند که همکاری بین کشورها کلید توسعه سیاست بهتری است که به نفع همه باشد.

کانادا، در کنار فرانسه، رهبری گروه بینالمللی هوش مصنوعی (IPAI) را برای ایجاد همکاری بین کشورها در راستای اجرای استراتژیهای هوش مصنوعی خود بر عهده داشت.

مک گی گفت: «ایده این پانل این است که همکاری بینالمللی را به روشی چندجانبه تسهیل میکند. این واقعاً بهمنظور ارائه مکانیسمی برای کشورها برای به اشتراک گذاشتن تحلیل و آیندهنگری چند رشتهای است.»

استروم توضیح داد که همکاری بین المللی در زمینه هایی مانند هوش مصنوعی ضروری است زیرا این فناوری از محیط هر کشوری فراتر می رود. هیچ حد و مرزی وجود ندارد، و بنابراین تقویت گفت و گوی بین المللی برای بهره مندی از بیشترین مزایای هوش مصنوعی بسیار مهم است.

استروم گفت: «فرصتی برای هوش مصنوعی برای ارائه مزایای اجتماعی و اقتصادی فوقالعاده مثبت برای جهان وجود دارد.

«اگر اشتباه متوجه شویم، یک فرصت واقعی از دست رفته وجود دارد. اما اگر آن را به درستی انجام دهیم، فرصت واقعاً فوقالعادهای برای به ارمغان آوردن منافع بزرگ دارد.»

منبع

شرایط استفاده از سایت indeed.com

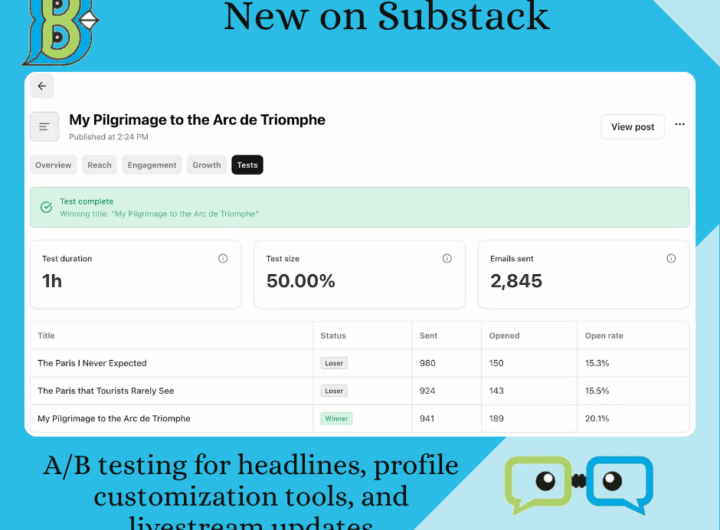

شرایط استفاده از سایت indeed.com  موارد جدید در Substack: تست A/B برای تیترها، ابزارهای سفارشیسازی پروفایل و بهروزرسانیهای پخش زنده

موارد جدید در Substack: تست A/B برای تیترها، ابزارهای سفارشیسازی پروفایل و بهروزرسانیهای پخش زنده  “شرایط استفاده” OpenAI (منتشرشده در ۱۱ دسامبر ۲۰۲۴)

“شرایط استفاده” OpenAI (منتشرشده در ۱۱ دسامبر ۲۰۲۴)  OPEN AI Terms in Farsi شرایط استفاده

OPEN AI Terms in Farsi شرایط استفاده  سرمایه داری داده و نژادپرستی الگوریتمی

سرمایه داری داده و نژادپرستی الگوریتمی  شفافیت در داده های ESG Data

شفافیت در داده های ESG Data